Di era infrastruktur IT modern, server overload bukan lagi sekadar kondisi ketika CPU mencapai 100%. Dalam praktiknya, overload sering muncul sebagai gabungan masalah: lonjakan trafik yang datang tiba-tiba, distribusi request yang tidak merata, origin server yang menanggung terlalu banyak konten statis, bottleneck pada database dan koneksi, cache yang tidak optimal, sampai gangguan keamanan seperti DDoS atau CC attack.

Kelebihan beban sistem melampaui kapasitas yang tersedia, dampaknya bisa langsung terasa: aplikasi melambat, request timeout, transaksi gagal, hingga layanan tidak dapat diakses sama sekali ini bisa menyebabkan bisnis anda merugi. Dalam artikel ini akan kami bahas apa penyebab dari Server Overload itu sendiri, dan bagaimana implementasi cloudnya, dimana – artinya solusinya tidak cukup hanya “menambah spesifikasi server” saja, tetapi harus menyentuh lapisan compute, network, cache, database, observability, dan security secara bersamaan, dalam hal ini kami gunakan Tencent Cloud untuk infrastukturnya yang menyediakan blok bangunan untuk tiap lapisan ini melalui Auto Scaling, Cloud Load Balancer, CDN/ECDN, Redis, TDSQL, TKE, SCF, serta Anti-DDoS.

Apa Itu Server Overload?

Server overload adalah kondisi ketika server menerima beban kerja melebihi kapasitas komputasi, memori, koneksi, atau resource pendukung lainnya. Dalam praktik modern, overload bisa terjadi meskipun spesifikasi server terlihat besar, karena sumber masalahnya sering berada di luar compute utama, misalnya antrean request yang menumpuk, origin server yang terlalu banyak melayani file statis, query database yang berat, atau pod aplikasi yang tidak bertambah saat trafik naik. Pada arsitektur cloud, masalah ini perlu ditangani secara menyeluruh di lapisan compute, network, storage, database, observability, dan security.

Penyebab Server Overload pada Infrastruktur IT Modern

Ada beberapa penyebab dan alasan kenapa Server sering overload, ini beberapa penyebabnya:

1. Lonjakan trafik yang datang tiba-tiba

Salah satu penyebab utama overload adalah trafik yang meningkat tajam dalam waktu singkat. Ini sering terjadi saat promo besar, peluncuran produk, kampanye digital, atau ketika aplikasi sedang viral. Jika kapasitas server bersifat tetap, maka instance yang tersedia akan menanggung seluruh beban sampai akhirnya kewalahan. dalam hal ini Tencent Cloud Auto Scaling, dirancang untuk menambah atau mengurangi jumlah instance CVM secara otomatis berdasarkan beban bisnis, sehingga kapasitas dapat menyesuaikan perubahan trafik tanpa menunggu intervensi manual.

2. Distribusi request yang tidak merata

Penyebab Selanjutnya, Banyak kasus overload sebenarnya bukan karena total trafik terlalu besar, tetapi karena trafik tidak dibagi secara sehat. Ada server yang “sangat sibuk”, sementara “server lain relatif longgar”. Tencent Cloud Cloud Load Balancer memvirtualisasikan beberapa server ke dalam satu pool layanan, melakukan health check, dan secara otomatis mengisolasi instance yang tidak sehat. CLB juga mendukung routing berbasis konten serta beberapa metode pembagian trafik seperti weighted round robin, IP hash, dan least connections. Dengan pendekatan ini, request dapat dibagi lebih merata dan risiko bottleneck pada satu node bisa ditekan.

3. Origin server terlalu banyak melayani konten statis

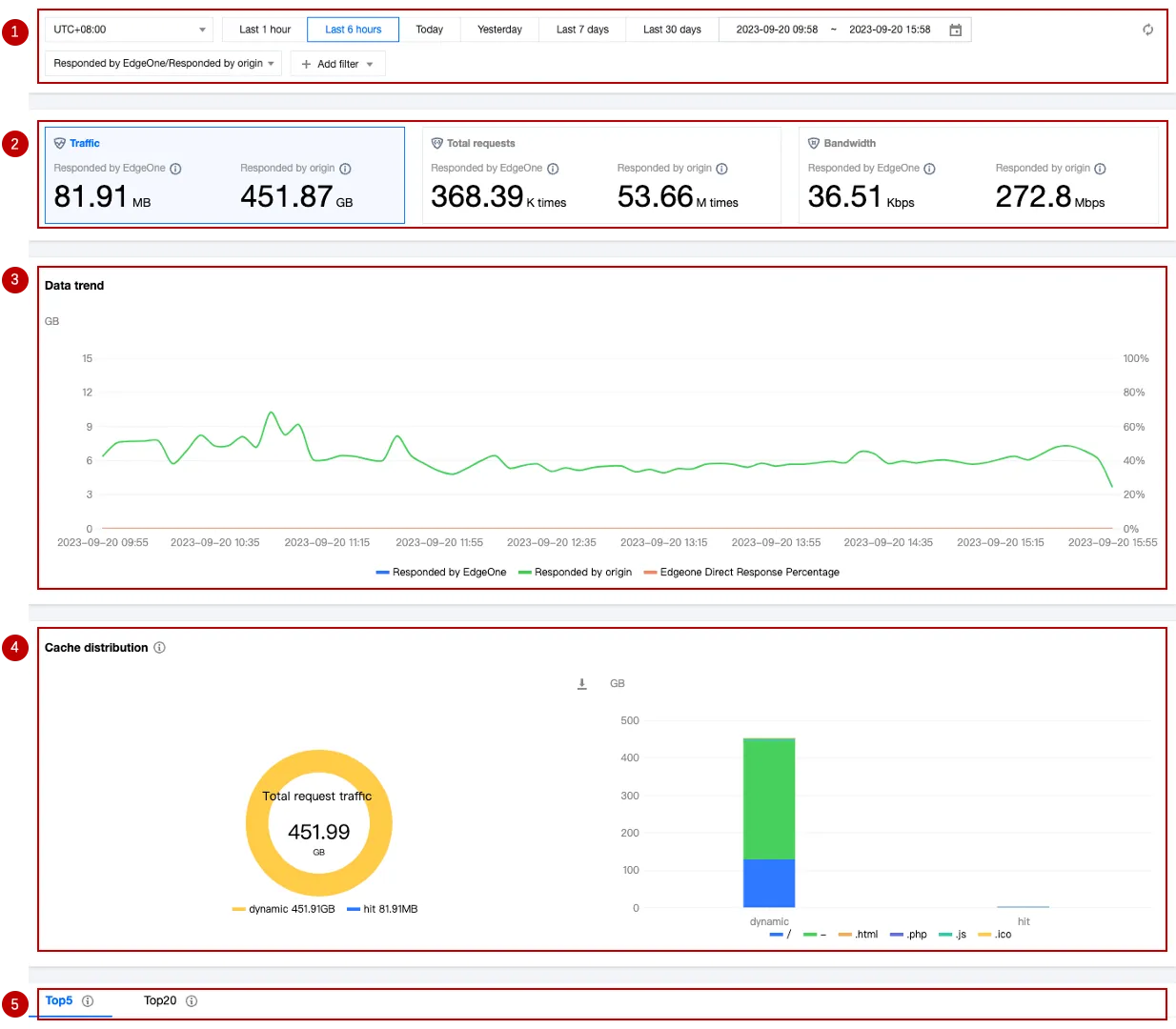

Aplikasi modern sering tetap memaksa origin server menangani file gambar, CSS, JavaScript, dan aset statis lain, padahal file seperti itu lebih efisien jika didistribusikan dari edge. Tencent Cloud menjelaskan bahwa untuk mengatasi keterbatasan performa server saat jam sibuk, file statis dapat disimpan di COS dan didistribusikan melalui CDN. Tencent Cloud CDN juga menyediakan monitoring untuk access traffic, origin-pull traffic, bandwidth, requests, hit rate, dan status code, sehingga tim dapat melihat seberapa besar beban yang berhasil dialihkan dari origin. Ini penting karena semakin banyak konten statis yang di-offload ke CDN, semakin ringan beban server aplikasi utama.

4. Bottleneck pada database

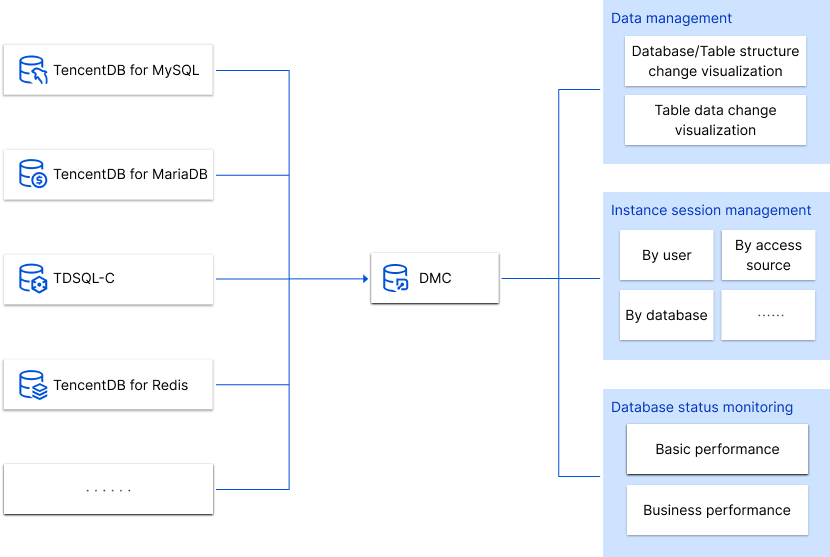

Penyebab selanjutnya, Database: adalah sumber overload yang sangat sering terabaikan. Saat jumlah koneksi meningkat, query makin kompleks, atau data tumbuh cepat, aplikasi bisa terasa lambat walaupun server aplikasi belum penuh. Tencent Cloud TDSQL for MySQL diposisikan sebagai database terdistribusi yang mendukung automatic horizontal sharding untuk mengatasi bottleneck performa database. Tencent juga menekankan bahwa zero-downtime elastic scaling dan online scale-out dapat dilakukan tanpa mengganggu operasi yang sedang berjalan. Artinya, ketika masalah berasal dari lapisan data, solusi yang dibutuhkan bukan sekadar menambah VM aplikasi, tetapi juga memperbaiki arsitektur database.

5. Cache yang tidak sehat dan hot key

Cache seharusnya mengurangi beban server dan database. Namun jika konfigurasi connection pool buruk, terjadi hot key, atau distribusi akses tidak seimbang, justru cache dapat menjadi titik lemah baru. Tencent Cloud Distributed Cache for Redis menyediakan monitoring transparan pada level proxy node, Redis node, dan instance summary. Tencent juga menyediakan analisis hot key karena trafik yang terlalu terkonsentrasi pada satu key dapat memicu masalah performa hingga downtime layanan Redis. Dalam konteks server overload, ini berarti masalah belum tentu ada di web server—bisa jadi akar masalah berada pada cache layer.

6. Autoscaling container belum optimal

Untuk aplikasi berbasis Kubernetes, overload sering terjadi ketika jumlah pod tidak bertambah saat beban naik atau ketika pod yang sebenarnya belum siap tetap menerima trafik. Tencent Kubernetes Engine mendukung Horizontal Pod Autoscaler yang dapat menambah jumlah pod berdasarkan CPU, memory, disk, network, GPU, dan metrik lain. Tencent juga menjelaskan fungsi readiness probe, yaitu memastikan container baru menerima request hanya ketika aplikasi benar-benar siap melayani trafik. Kombinasi autoscaling dan health check seperti ini sangat penting agar beban puncak tidak berubah menjadi kegagalan berantai.

7. Workload bursty masih dibebankan ke server utama

Tidak semua proses harus selalu berjalan di server yang aktif 24 jam. Job seperti webhook, background processing, log handling, atau event tertentu lebih efisien dipindahkan ke arsitektur serverless. Tencent Cloud Serverless Cloud Function merupakan layanan event-driven yang dapat melakukan scaling otomatis berdasarkan volume request, dari trafik kecil hingga ribuan request per detik, tanpa konfigurasi manual di sisi kapasitas. Dengan memindahkan beban-beban tertentu ke SCF, server utama dapat difokuskan untuk melayani proses inti aplikasi.

8. Serangan trafik seperti DDoS atau CC attack

Kadang overload bukan murni karena pertumbuhan pengguna, melainkan karena “trafik berbahaya”. Gejalanya bisa tampak mirip: koneksi penuh, respons melambat, dan layanan tidak stabil. Tencent Cloud menyatakan Anti-DDoS Basic aktif secara default untuk resource tertentu di Tencent Cloud, memonitor trafik secara real time, dan memulai pembersihan trafik serangan dalam hitungan detik setelah ancaman terdeteksi. Ini penting karena tim operasional sering keliru mengira serangan sebagai lonjakan trafik normal, padahal penanganannya sangat berbeda.

9. Monitoring dan alarm yang terlambat

Banyak insiden server overload memburuk karena tim baru sadar setelah pengguna sudah terdampak. Tencent Cloud Alarm Service memungkinkan pembuatan alarm berdasarkan threshold metrik tertentu dan mendukung notifikasi melalui SMS, WeChat, email, panggilan telepon, dan webhook. Dikombinasikan dengan monitoring pada CDN, Redis, TKE, dan service lainnya, alarm dapat menjadi lapisan pencegahan yang sangat penting. Dengan kata lain, overload seharusnya dideteksi lebih awal dari anomali CPU, memori, latency, error rate, hit rate cache, atau jumlah koneksi, bukan menunggu sistem benar-benar tumbang.

Cara Mengatasi Server Overload dengan Pendekatan Tencent Cloud

Untuk mengatasi server overload secara efektif, organisasi perlu membangun arsitektur yang elastis dan terdistribusi. Di Tencent Cloud, pola dasar yang umum adalah menggunakan Auto Scaling untuk menambah instance saat beban naik, lalu Cloud Load Balancer untuk membagi trafik secara merata ke backend yang sehat. Pendekatan ini cocok untuk aplikasi web, API, maupun layanan internal yang berjalan di atas CVM.

Setelah itu, beban origin perlu dikurangi dengan CDN dan COS untuk aset statis. Langkah ini membantu mengurangi konsumsi bandwidth, request ke origin, dan latensi akses pengguna. Untuk aplikasi yang mulai berat di lapisan data, TDSQL dan Redis dapat digunakan untuk memperkuat database dan cache, termasuk dalam skenario skala besar, hot key analysis, dan kebutuhan scale-out.

Jika aplikasinya berbasis container, TKE dengan HPA, readiness probe, dan health check akan membantu memastikan jumlah pod selalu sesuai dengan kebutuhan trafik. Sementara untuk proses yang sifatnya event-driven atau bursty, SCF dapat memindahkan beban tertentu dari server utama ke model komputasi yang otomatis menskalakan resource sesuai kebutuhan.

Lapisan terakhir yang tidak kalah penting adalah security dan observability. Anti-DDoS membantu menyaring trafik berbahaya, sedangkan alarm dan monitoring membantu tim mendeteksi gangguan lebih dini. Tanpa dua komponen ini, peningkatan kapasitas saja sering tidak cukup untuk menjaga layanan tetap stabil.

Kesimpulan

Penyebab server overload pada infrastruktur IT modern sangat beragam: mulai dari lonjakan trafik, pembagian beban yang tidak sehat, bottleneck database, cache yang bermasalah, hingga serangan DDoS. Karena itu, cara mengatasinya tidak bisa hanya dengan upgrade spesifikasi server. Dari perspektif implementasi di Tencent Cloud, pendekatan yang lebih tepat adalah membangun arsitektur elastis dengan Auto Scaling, Load Balancer, CDN, TKE, Redis, TDSQL, serverless, serta monitoring dan proteksi trafik yang memadai. Dengan desain seperti ini, server overload dapat dicegah lebih awal, bukan hanya ditangani setelah sistem mengalami gangguan.